如何保护您的图像免受AI侵害

虽然用 AI 生成器模仿梵高或弗里达卡罗等已逝艺术家的作品很有趣,但对在世艺术家来说却并非如此。 允许几乎任何人以“艺术家的风格”创作图像可能会导致他们的市场充斥着仿冒品; 增加对真实性的混淆和潜在的收入损失。

作为回应,人们正在寻找一种方法来保护他们的图像免受 AI 艺术生成器的影响。 答案可能并不完美或万无一失,但有一些方法可以保护您的图像不被 AI 艺术生成器使用。

推荐:WooCommerce电子邮件定制器插件YayMail

人工智能生成器如何获取您的图像

AI 艺术生成器经过一段时间的“训练”,学习如何在收到文本提示时生成图像。 作为学习过程的一部分,它需要研究数以亿计的图像-文本对,以最终生成真实世界物体、颜色和场景以及艺术技巧和风格的准确图像。

碰巧的是,人工智能模型必须从人类的创造力中学习。 例如,Midjourney 和 Stability Diffusion 是两个在开源 LAION-5B 数据集上训练的 AI 艺术生成器,其中包含来自互联网的数十亿张图像。

使用网络爬虫“抓取”网站数据,这些数据集创建图像 URL 列表及其标题,类似于一个巨大的 Excel 电子表格。 如果你在网上发布了你的艺术作品,那么它可能会出现在图像数据集中,因此被用来训练 AI,无论你是否同意。

1. 选择退出 AI 训练数据集

Spawning 是一群艺术家,他们的热门网站 Have I Been Trained? 可用于查看您的图像是否在 LAION-5B 数据集中。 他们自己决定,后来添加了选择退出数据集的功能。 根据一项协议,Spawning 会将用户选择退出列表传递给 LAION,LAION 表示将尊重请求并从其收藏中删除这些图像。

Spawning 的选择退出工具仍然需要一些开发,因为在撰写本文时,您无法一次添加多个图像。 也没有与任何其他可能用于训练 AI 模型的数据集签订退出协议。

由于许多 AI 公司不披露有关其 AI 模型构建方式的更详细信息,因此有时并不清楚他们使用的是什么数据集。 DALL-E 是一种流行的 AI 艺术生成器,它不共享此信息。

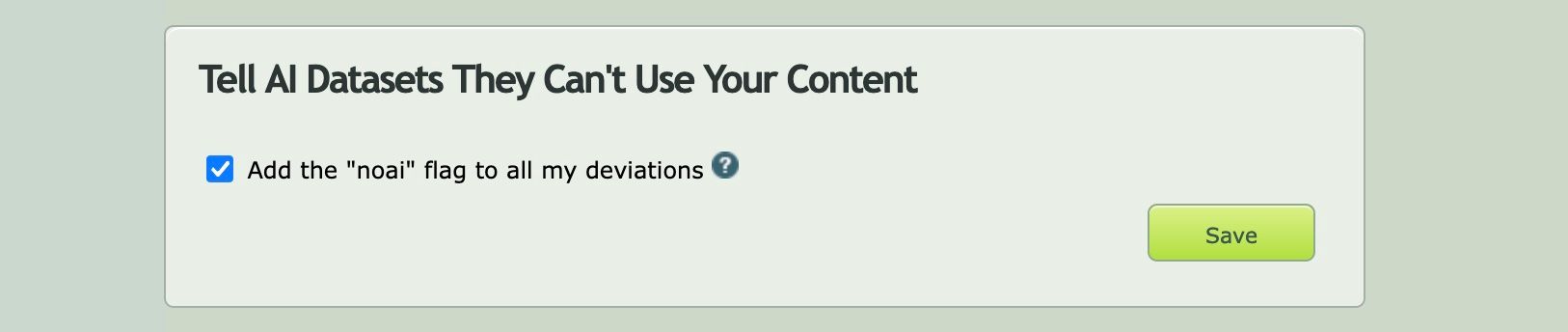

或者,如果您使用 DeviantArt 分享您的作品,您的图像现在默认受到保护,不会被用于 AI 训练数据集。 它的工作原理是用“noai”标记你的图像,这意味着如果发现人工智能模型使用你的图像进行训练,它将违反 DeviantArt 的服务条款。

当然,这些选择退出措施不是强制执行的,因此如果第三方愿意,他们可以忽略它们。 虽然这不是最有效的解决方案,但它正在引领更多规则和法规保护艺术家作品的道路。

在理想的世界中,人们可以选择加入,而不是必须选择退出。 我们希望在未来看到这种情况发生。 有关如何从数据集中删除图像的更多详细信息,请参阅我们关于如何从 AI 训练中选择退出图像的指南。

2.版权你的作品

从互联网上抓取图像的做法是否合法已引起法院的注意。 而帮助艺人为自己出示证据,就是他们拥有的图片版权。

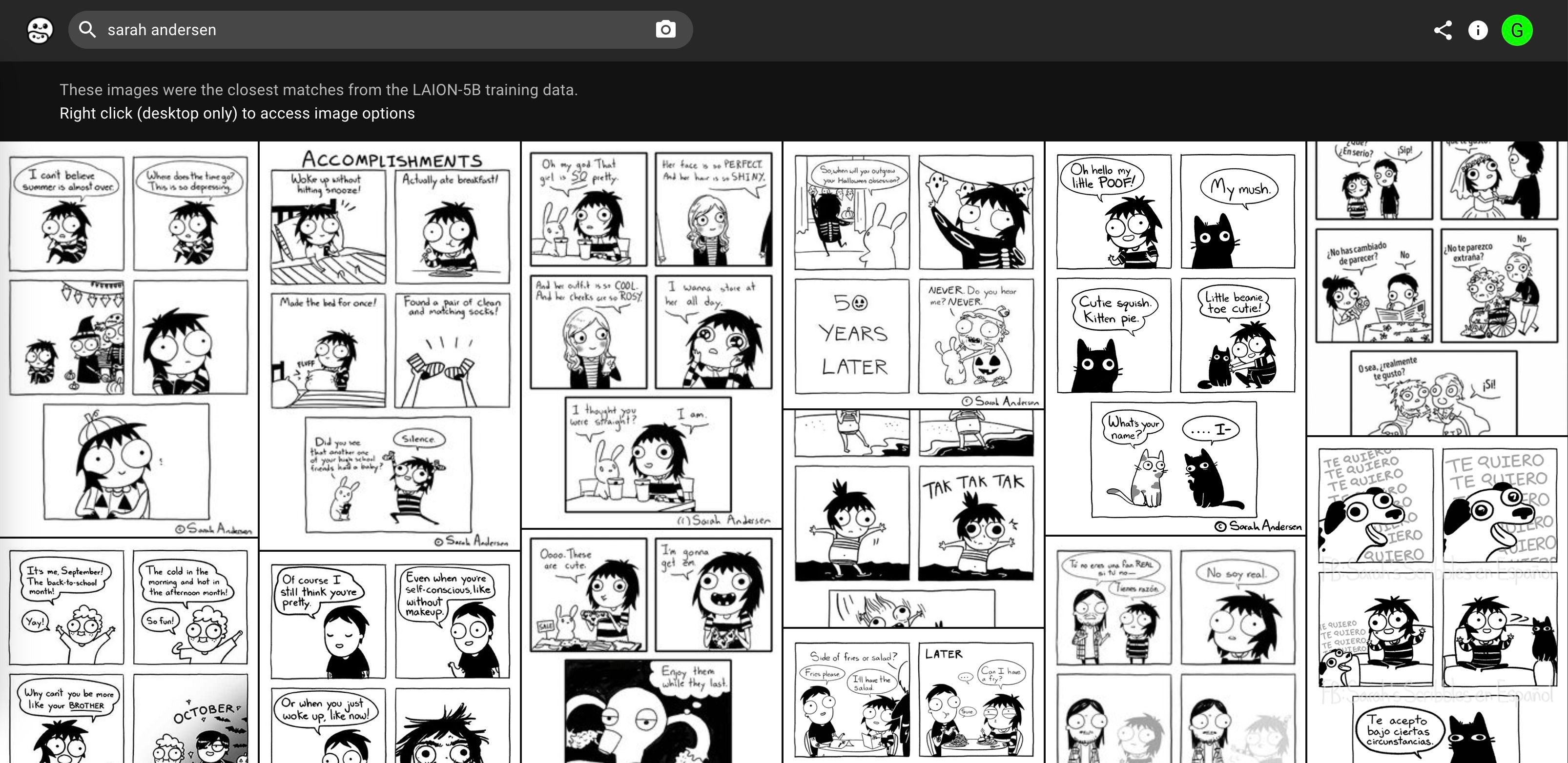

2023 年初,知名漫画家莎拉·安徒生 (Sarah Andersen) 是一群艺术家的一员,他们对人工智能公司 Stability AI 和 Midjourney 以及艺术分享网站 DeviantArt 提起诉讼,要求其抓取作品未经同意擅自使用他们的艺术作品——包括无数其他艺术家的艺术作品。

另一个例子是股票图片网站 Getty Images,它对 Stability AI 提起诉讼,指控其未经许可抓取其图像。 它发现其版权图像被使用的方式是当 AI 生成的图像开始显示带有 Getty Images 水印时——这是一个非常明显的赠品。

虽然合法性将在适当的时候确定,但正如我们提到的案例所示,版权是为数不多的可以用来为艺术家作品争取权利的东西之一。 它可能不是最新的人工智能技术,但它可以加强你的防御能力。

无论如何,这是一种非常值得学习的做法,因此无论是否涉及 AI,您都可以保护您的工作不被盗用。 按照我们关于如何为您的照片版权的指南,深入了解它是如何工作的。

3. 使用 Robots.txt 阻止网站爬虫

图像数据集只能索引大量图像,因为它们使用了一种叫做网络爬虫的东西。 顾名思义,他们在网站上爬行以搜索特定信息。

一些爬虫很有用,可以帮助 Google 等搜索引擎找到最相关的信息并将其编入索引,以显示在其搜索结果页面上。 其他用于抓取网站图像以包含在 AI 训练数据集中。

这就是 Robots.txt 的用武之地。Robots.txt 是一个文本文件,可以放在网站的后端代码中,告诉网络爬虫他们可以扫描什么,不能扫描什么。 您可以使用它来阻止爬虫查看某些页面或文件,如果您不希望 AI 使用您的图像,这将很有帮助。

如果您想了解更多信息,请阅读我们关于什么是网络爬虫及其工作原理的指南。 对于那些拥有网站的人,请让您的网络开发人员在您的网站代码中嵌入 Robots.txt,以防止您的图像被 AI 训练数据集废弃。

未来会发生什么

与 AI 模型竞争令人沮丧,但更多解决方案正在开发中。

一方面,法院诉讼程序正在确定什么是合法的以及版权如何与 AI 图像生成一起使用。 这些公开辩论的结果将制定 AI 公司必须遵守的法律标准,并可能会制定相应的法规。

另一方面,开发人员正在思考如何使用新技术解决问题。 在一项很有前途的研究中,研究表明,您可以通过将图像渲染为 AI 训练数据集“无法学习”来使用 AI 来对抗自己。

正如墨尔本大学的 Sarah Monazam Erfani 博士所解释的那样:“我们设计了一种基于机器学习的技术,该技术可以识别和更改图像中足够多的像素来混淆 AI 并将其变成‘无法学习’的图像。这种变化非常明显小且人眼难以察觉,但它会在图像中引入足够的“噪声”,使其无法用于训练人工智能。”

如果您是受 AI 图像生成器影响的人,那么值得让人们听到您的声音,以便这些公司被迫改变他们的做法。 正是因为 DeviantArt 社区的强烈反馈,才创建了一个新的选择退出偏好,因此请务必向艺术共享平台和 AI 公司提供反馈。

保护您的图像免受 AI 侵害

您可以通过选择退出 AI 训练数据集、对您的图片进行版权保护以及使用 Robots.txt 标准来保护您的图像免受 AI 艺术生成器的影响。 虽然它不能保证您的图像远离 AI 系统,但在开发出更多解决方案之前,使用所有这三种方法将为您提供最佳防御。

新工具正在开发中,包括在不知不觉中调整图像的方法,使 AI 无法从中学习,从而使其无法用于训练 AI 艺术生成器。 与此同时,不要放弃。 仍然有一些方法可以保护您的图像免受 AI 艺术生成器的影响。